¿Alguna vez has imaginado coordinar varios agentes de IA trabajando juntos, cada uno responsable de una parte específica de la automatización? Esa es exactamente la propuesta de LangGraph.

A lo largo de este artículo, exploraremos qué es LangGraph, sus principales funcionalidades, casos de uso y cómo crear tu primer proyecto con LangGraph.

Mi mensaje de costumbre: toma un café, corrige tu postura en la silla y sumerjámonos profundamente en el universo de esta herramienta de IA.

LangGraph es un framework del ecosistema LangChain concebido para facilitar la creación y orquestación de agentes de IA basados en modelos de lenguaje de gran tamaño, también conocidos como LLMs (Large Language Models)

Página de inicio de LanGraph

Permite definir, coordinar y ejecutar flujos de trabajo complejos utilizando una estructura orientada a grafos, donde cada nodo representa una etapa computacional y sus conexiones determinan el flujo de datos y de control entre las etapas.

Esto hace posible construir sistemas multiagentes robustos y escalables, con gestión de estado a lo largo del tiempo y lógica condicional, yendo más allá de los encadenamientos lineales comunes en soluciones tradicionales

La importancia de LangGraph en el contexto de automatizaciones multiagente

LangGraph es fundamental en el contexto de automatización multiagente porque ofrece una estructura clara y flexible para orquestar múltiples agentes de IA de forma coordinada y eficiente, permitiendo que cada agente ejecute tareas específicas dentro de un flujo controlado por grafos.

Este enfoque facilita la gestión de estados complejos, favorece la interacción dinámica entre agentes y viabiliza la toma de decisiones basadas en el contexto.

Lo cual es esencial para construir sistemas automatizados avanzados, capaces de realizar procesos colaborativos y adaptativos en diversos entornos.

Así, LangGraph contribuye directamente al desarrollo de soluciones más robustas e inteligentes en el campo de las automatizaciones multiagentes, superando las limitaciones de los métodos tradicionales basados en secuenciación lineal.

¿Cómo funciona LangGraph?

El funcionamiento de LangGraph se basa en grafos dirigidos, en los cuales el estado de la aplicación se mantiene y actualiza a medida que se ejecutan los nodos.

De esta forma, permite que el flujo de ejecución dependa del historial, de variables internas y de datos contextuales acumulados a lo largo del proceso.

Este modelo lo hace adecuado para escenarios que demandan procesos de razonamiento en múltiples etapas, orquestación de agentes inteligentes y flujos de trabajo condicionales, como chatbotsavanzados y sistemas colaborativos distribuidos.

Principales funcionalidades de LangGraph

Existen características y funcionalidades que convierten a LangGraph en una herramienta poderosa y versátil para el desarrollo de soluciones avanzadas en Inteligencia Artificial. Algunas de ellas son:

- Definición de flujos de trabajo: Permite crear flujos estructurados en grafos, donde cada nodo representa una tarea y las conexiones definen la secuencia y condiciones para la ejecución, facilitando procesos complejos y dinámicos.

- Gestión automática de estado: Mantiene la persistencia de la información a lo largo de la ejecución, permitiendo que los agentes continúen tareas con contexto e historial, incluso después de pausas o interrupciones.

- Coordinación de agentes autónomos: Soporta agentes independientes que ejecutan tareas basadas en datos y lógica, interactuando entre sí y adaptándose a nuevas condiciones, promoviendo una automatización avanzada y colaborativa.

- Integración con APIs: Facilita la conexión con otras APIs y herramientas de IA para ampliar las funcionalidades y los datos disponibles en los flujos.

- Personalización y escalabilidad: Permite ajustar el comportamiento de los agentes a las necesidades específicas del proyecto, soportando un gran volumen de interacciones y múltiples agentes simultáneos.

- Ejecución optimizada y orquestación inteligente: Compila el grafo en un objeto eficiente que gestiona llamadas, mantiene estados globales y controla el flujo incluyendo bucles (loops) condicionales, ejecución paralela e intervención humana cuando sea necesario.

No podemos olvidar que, como toda buena tecnología disponible, LangGraph también posee una documentación oficial. Accede aquí: Documentación LangGraph.

Beneficios de usar LangGraph

LangGraph aporta beneficios significativos al desarrollo de sistemas de IA al simplificar la creación y coordinación de flujos multiagentes. Podemos mencionar:

- Simplificación del desarrollo: LangGraph abstrae las complejidades de la gestión de estado y la coordinación de agentes, acelerando la creación de flujos complejos y minimizando errores.

- Persistencia de contexto: Los agentes mantienen la información entre sesiones, lo que evita la necesidad de crear soluciones propias para almacenamiento y mejora la experiencia y confiabilidad de las aplicaciones.

- Visualización y depuración: Posee gestión visual de los flujos, lo que facilita el monitoreo de los estados y las decisiones de los agentes en cada etapa del proceso.

- Extensibilidad: Trabaja integrado al ecosistema LangChain y ofrece componentes para una personalización total, soportando sistemas complejos y escalables.

- Control y moderación: Incluye soporte para supervisión humana en tiempo real, con aprobaciones y moderación para garantizar decisiones seguras y alineadas con los requisitos del negocio.

Una de las maneras de comenzar a explorar LangGraph es usarlo directamente en tu navegador con Google Colab, sin necesidad de instalar nada localmente.

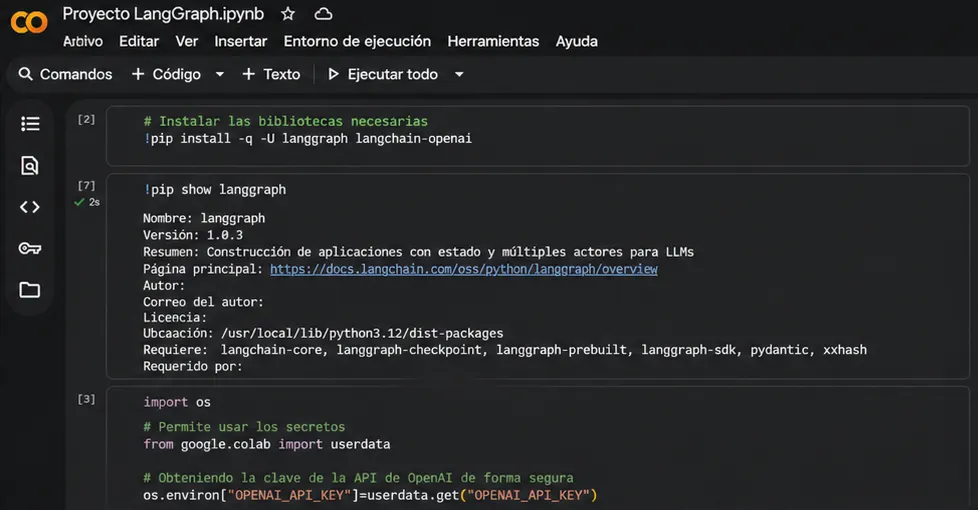

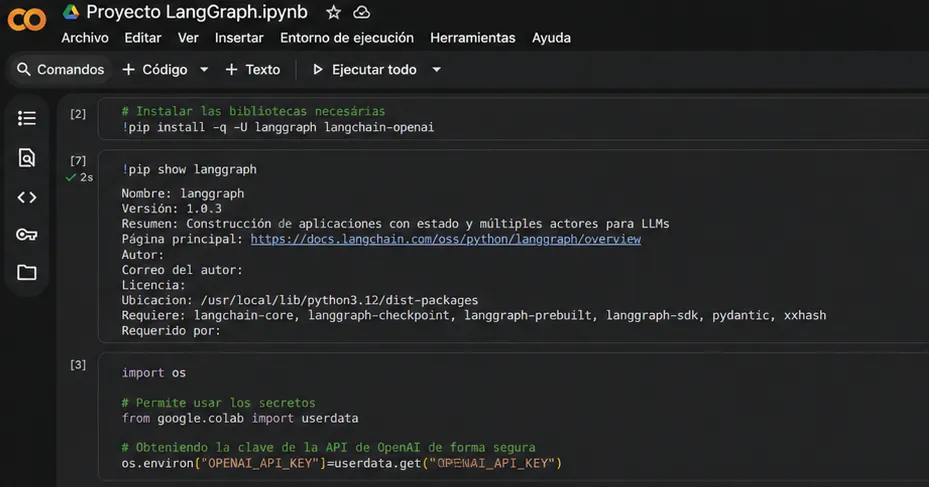

Paso 1: Instalación de LangGraph en Google Colab

- Accede a un nuevo notebook en Google Colab: colab.new

- En una celda de código escribe el siguiente comando:

# Instalar bibliotecas necesarias

!pip install -q -U langgraph langchain-openai- Ejecuta la celda (usa el botón “Play” o el atajo “Ctrl + Enter”).

- Espera a que finalice la instalación y listo, ya tenemos LangGraph en Google Colab.

- Por último, haz clic en el botón “+ Código” para crear una nueva celda y verifica la instalación ejecutando el comando:

!pip show langgraph

Si la instalación se completó con éxito, podrás visualizar alguna información de LangGraph.

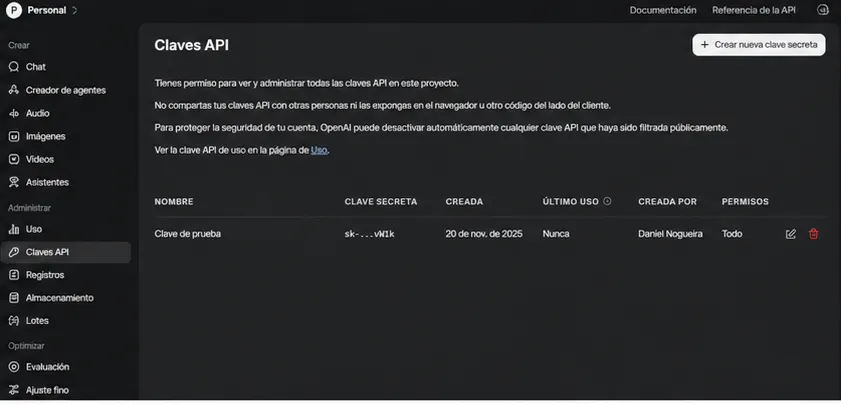

Paso 2: Creación de una API Key

Antes de comenzar a crear un proyecto con LangGraph, será necesario tener a mano una API Key de OpenAI (empresa creadora de ChatGPT.

Una API Key funciona como una llave que permite la conexión con los servicios de OpenAI y el uso de sus modelos de lenguaje (como el GPT-4) en tus proyectos.

Paso a paso

- Accede a la página de API Keys de OpenAI: platform.openai.com/api-keys.

- Haz clic en “Login” o en “Sign Up” (en caso de que aún no tengas una cuenta).

- Después de iniciar sesión, haz clic en el botón “Create new secret key” en la esquina superior derecha de la pantalla.

- En el campo “Name”, escribe un nombre para la llave. Por ejemplo: “LangGraph Key”.

- Finalmente, haz clic en “Create secret key” y se mostrará una ventana con la llave.

- Haz clic en “Copy” para copiar la llave y luego en “Done” para cerrar la ventana.

- Pega esta llave (inmediatamente) en algún editor de texto en tu computadora para no perderla.

Observación: ¡Nunca compartas tu llave públicamente (en GitHub o en foros), es de extrema importancia que solo tú tengas la visualización completa de ella!

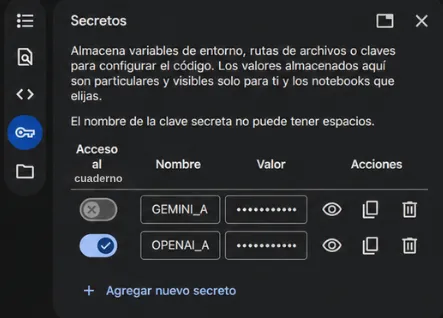

Paso 3: Configuración de un secret en Google Colab

Y ahora necesitamos configurar la llave de API como un “secret” en Google Colab. Para ello:

- En la barra lateral izquierda de Google Colab, haz clic en el botón de la llave, llamado “Secrets”.

- Haz clic en “+ Add new secret”.

- En el campo “Name”, escribe: “OPENAI_API_KEY”.

- En el campo “Value”, pega aquella llave de API creada en el sitio de OpenAI.

- Habilita el acceso al notebook haciendo clic en la opción al lado del nombre de la llave.

Paso 4: Configuración del entorno de LangGraph

Ahora estamos listos para ejecutar algunas instrucciones iniciales para el funcionamiento de LangGraph. Para ello, crea una nueva celda de código e inserta los comandos de abajo:

import os

# Permite usar los secrets

from google.colab import userdata

# Obteniendo la llave de OpenAI de forma segura

os.environ['OPENAI_API_KEY']=userdata.get('OPENAI_API_KEY')¡Finalmente, ejecuta el bloque de código!

![Image 6: Notebook Colab configurando LangGraph para Python, con instalación vía pip, verificación de la versión 1.0.3 y uso seguro de la llave de la API de OpenAI con userdata.]()

Paso 5: Creación de un proyecto LangGraph

A continuación, se presenta el código de un proyecto completo en LangGraph. Escribe el código en una nueva celda de Colab y lee los comentarios que explican cada etapa del proceso:

# Proyecto LangGraph

# Importaciones principales

from langgraph.graph import StateGraph, END

from langchain_openai import ChatOpenAI

from typing import TypedDict

# Definición del estado global

class Estado(TypedDict):

pregunta: str

respuesta: str

# Iniciando el modelo LLM

modelo = ChatOpenAI(model="gpt-4o-mini")

# Nodo 1: Recibe y muestra la pregunta

def nodo_recibir_pregunta(state: Estado):

print("🔹 Pregunta recibida:", state["pregunta"])

return state

# Nodo 2: Genera la respuesta vía LLM y la guarda en el estado

def nodo_generar_respuesta(state: Estado):

pregunta = state["pregunta"]

respuesta = modelo.invoke(pregunta) # Llamada al LLM

state["respuesta"] = respuesta.content

print("🔹 Respuesta generada con éxito.")

return state

# Construyendo el grafo

grafo = StateGraph(Estado)

grafo.add_node("recibir_pregunta", nodo_recibir_pregunta)

grafo.add_node("generar_respuesta", nodo_generar_respuesta)

grafo.add_edge("recibir_pregunta", "generar_respuesta")

grafo.add_edge("generar_respuesta", END)

# Definiendo el inicio del flujo

grafo.set_entry_point("recibir_pregunta")

# Compila el grafo

app = grafo.compile()Solo después de leer los comentarios y entender cada paso del proyecto, ejecuta el código. Y calma… no sucede nada tras la ejecución. Esa parte viene ahora:

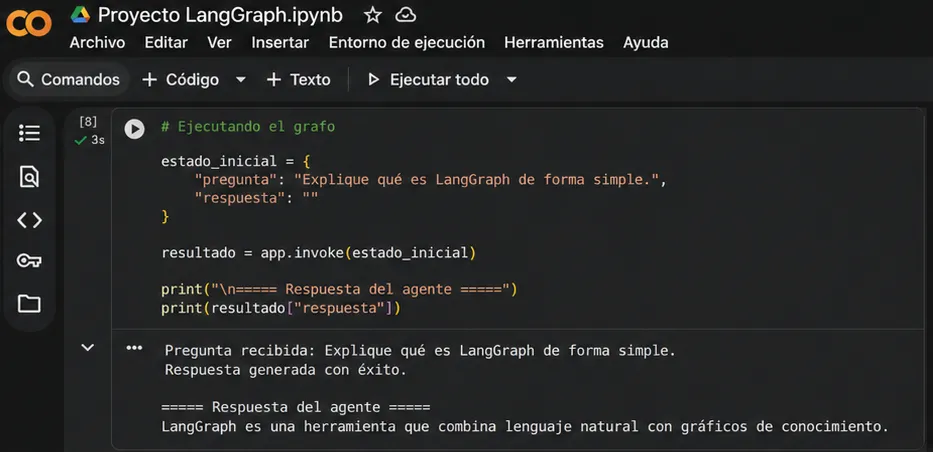

En una nueva celda, escribe el siguiente código:

# Ejecutando el grafo

estado_inicial = {

"pregunta": "Explica qué es LangGraph de forma sencilla.",

"respuesta": ""

}

resultado = app.invoke(estado_inicial)

print("\n===== Respuesta del agente =====")

print(resultado["respuesta"])¡Ahora solo tienes que ejecutarlo, esperar la respuesta y listo! Ya has logrado dar tus primeros pasos con LangGraph. Aprovecha para personalizar el código como quieras, usa tu creatividad.

Casos de uso de LangGraph

LangGraph es una herramienta versátil que puede aplicarse en diversos contextos.

Ya sea en el desarrollo de chatbots más avanzados o de asistentes virtuales, permite crear soluciones capaces de automatizar procesos complejos y mejorar la experiencia del usuario, atendiendo a diferentes sectores y demandas de forma eficiente. Algunos casos de uso:

Chatbots avanzados

LangGraph permite crear chatbots avanzados que logran entender contextos complejos y mantener el historial completo de las conversaciones, lo que resulta en respuestas coherentes y personalizadas incluso en interacciones largas y polifacéticas.

Con la capacidad de coordinar múltiples agentes que ejecutan funciones específicas, estos chatbots pueden alternar entre diferentes temas de manera fluida, mejorando significativamente la experiencia del usuario al ofrecer soporte proactivo y soluciones eficaces.

Asistentes virtuales inteligentes

Con LangGraph, es posible desarrollar asistentes virtuales capaces de realizar tareas complejas, como agendar citas teniendo en cuenta múltiples factores y preferencias del usuario.

Estos asistentes automatizan procesos que normalmente demandan intervención humana, integrándose a sistemas externos para recolectar información y tomar decisiones dinámicas, lo que aumenta la productividad y reduce el tiempo dedicado a tareas repetitivas.

Monitoreo de salud

LangGraph viabiliza la orquestación de agentes para el monitoreo continuo de pacientes, análisis detallado de datos clínicos y respuesta automatizada a emergencias.

Esto contribuye a mejorar la precisión y agilidad en la atención médica, permitiendo que se realicen intervenciones rápidamente basadas en datos actualizados, además de facilitar el seguimiento personalizado de la salud de los pacientes en tiempo real.

Detección de fraudes y análisis de datos

En sectores como el financiero, LangGraph puede usarse para construir flujos de decisión complejos que identifican fraudes al evaluar múltiples criterios y mantener el contexto de las transacciones a lo largo del proceso.

Esta orquestación permite analizar datos en varias etapas, involucrar a especialistas cuando sea necesario y tomar decisiones rápidas y precisas, aumentando la seguridad y la confiabilidad de los sistemas financieros.

Enseñanza y aprendizaje

El uso de inteligencia artificial en la educación ya no es un proceso de innovación, sino una necesidad.

En este contexto, LangGraph puede utilizarse para crear entornos de aprendizaje personalizados, en los cuales múltiples agentes evalúan el progreso de los estudiantes, ofrecen ejercicios a medida y proporcionan retroalimentación en tiempo real.

Este enfoque permite mantener un seguimiento continuo y eficaz del desempeño y de las preferencias individuales, potenciando la experiencia educativa y favoreciendo el aprendizaje adaptativo e interactivo.

La integración de LangGraph con otras herramientas es uno de sus mayores diferenciales, permitiendo que los agentes creados con él accedan a una amplia gama de recursos externos de forma directa y eficiente.

Al ser parte del ecosistema LangChain, LangGraph puede conectarse fácilmente a diversos modelos de lenguaje y proveedores de IA como OpenAI, Anthropic, Hugging Face, Azure y Google Cloud. Además, también hay integración con APIs externas, bases de datos y herramientas de búsqueda.

Esta capacidad hace posible que, durante la ejecución de un flujo de trabajo, los agentes utilicen servicios especializados, consulten información en tiempo real y realicen llamadas a APIs, todo orquestado de manera cohesiva dentro del grafo.

Integración con LangSmith

Además, LangGraph se integra con plataformas de monitoreo como LangSmith, que facilita el análisis y la depuración de los agentes, permitiendo rastrear el desempeño de cada etapa e identificar posibles cuellos de botella o errores.

Esta interoperabilidad hace de LangGraph una herramienta poderosa para construir sistemas de IA complejos y adaptables, que combinan lo mejor de múltiples tecnologías sin la necesidad de desarrollar todo desde cero, acelerando el desarrollo y garantizando mayor robustez y flexibilidad.

Conclusión

A lo largo del artículo, vimos cómo LangGraph amplía el potencial de las automatizaciones multiagentes, permitiendo crear flujos robustos, adaptativos y transparentes.

También exploramos sus funcionalidades, integraciones, beneficios y casos de uso, evidenciando cómo el framework se destaca al unir flexibilidad, escalabilidad y profundidad técnica.

En un escenario donde las aplicaciones de IA demandan cada vez más autonomía y control, LangGraph surge no solo como una solución poderosa, sino como una base sólida para el futuro de las automatizaciones inteligentes.

FAQ | Preguntas frecuentes sobre LangGraph

1. ¿Qué es LangGraph y para qué sirve?

LangGraph es un framework de Python que permite construir flujos de trabajo de Inteligencia Artificial con estado persistente usando estructuras basadas en grafos. Es ideal para crear agentes de IA complejos que pueden adaptarse dinámicamente a condiciones, entradas del usuario y resultados.

2. ¿Cuáles son las principales ventajas de LangGraph sobre otras herramientas de IA?

Además de la coordinación multiagente y el soporte al estado persistente, LangGraph posibilita ramificaciones condicionales, bucles, tratamiento de errores e intervención humana en los flujos de trabajo, otorgando flexibilidad y robustez para aplicaciones avanzadas como chatbots y sistemas colaborativos.

3. ¿Cómo gestiona LangGraph el estado y la memoria durante la ejecución?

LangGraph mantiene el estado global durante todo el ciclo de vida del flujo de trabajo, almacenando información importante que permite gestionar conversaciones y tareas de larga duración sin pérdida de contexto. También facilita la integración con componentes de memoria, como bases de datos vectoriales.

4. ¿LangGraph es compatible con qué modelos y servicios de IA?

Se integra fácilmente con los principales proveedores de modelos LLM, como OpenAI, Anthropic, Hugging Face y servicios en la nube como Azure y Google Cloud. También soporta llamadas directas a APIs externas, facilitando la ampliación de las capacidades de los agentes.

5. ¿Necesito usar LangChain para utilizar LangGraph?

No es obligatorio usar LangChain para utilizar LangGraph. Aunque forman parte del mismo ecosistema y pueden integrarse, LangGraph es un framework independiente enfocado en la orquestación de agentes con grafos y estado persistente.

6. ¿Cuál es el costo de usar LangGraph?

LangGraph es un software de código abierto (open source) gratuito para su uso y desarrollo. Sin embargo, pueden ocurrir costos adicionales al integrar proveedores externos de modelos LLM o servicios en la nube, los cuales poseen sus propias políticas de facturación.