- Modelos generalistas

- Modelos especializados

- Modelos compactos

- Modelos multimodales

- Conclusión

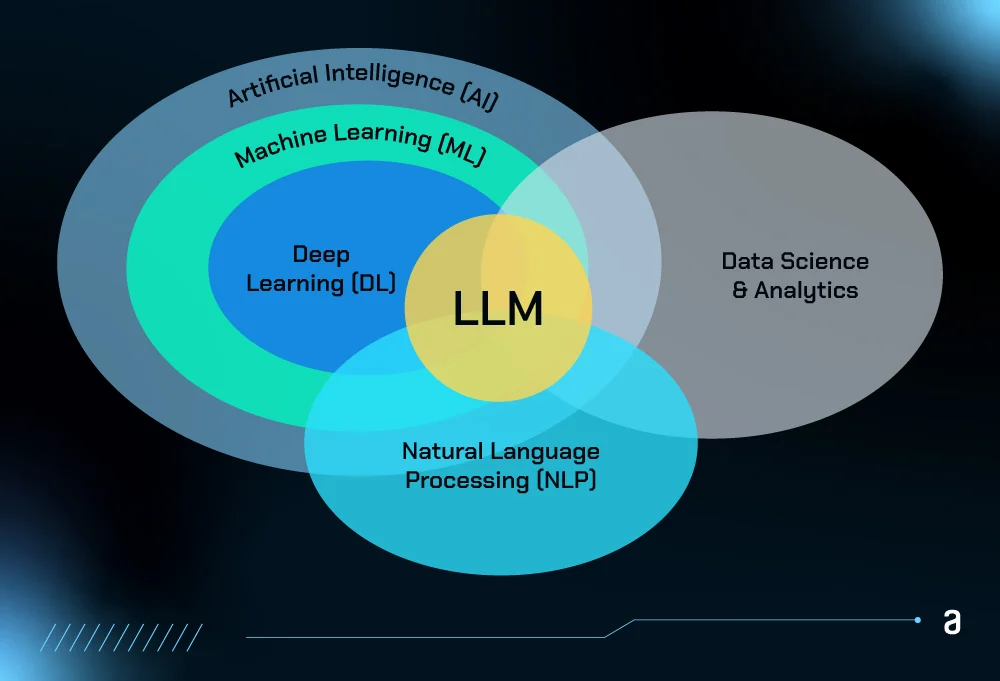

¿Alguna vez te has preguntado cómo funcionan los diferentes tipos de modelos de lenguaje que están dando forma al futuro de la inteligencia artificial?

En este artículo, vamos a explorar los bastidores de estas máquinas increíbles que no solo entienden texto, sino que también procesan imágenes, sonidos e incluso videos.

Prepárate para sumergirte en el universo de los LLM (Large Language Models), donde cada tipo tiene sus habilidades únicas y desafíos propios.

Comenzamos con los modelos generalistas, las navajas suizas de la IA, que hacen un poco de todo, pero exigen cuidado con sus famosas alucinaciones.

En seguida, pasamos por los modelos especializados, los expertos enfocados que dominan áreas específicas como salud y finanzas.

Para quienes buscan eficiencia en dispositivos más pequeños, tenemos los modelos compactos, las versiones "fitness" que garantizan privacidad y performance local.

Y, claro, no podemos olvidar los modelos multimodales, los políglotas que conectan texto, imagen, audio y video de forma integrada.

Vamos a discutir qué es lo que hacen mejor, los cuidados necesarios y cómo cada tipo puede transformar la manera en que interactuamos con la tecnología.

Entonces, si quieres entender más sobre este universo fascinante, toma un cafecito (o tu bebida favorita, sin resentimientos) y acompáñame, ¡porque este artículo es para ti!

Modelos generalistas

Los modelos generalistas son, como su nombre lo sugiere, aquellos entrenados para lidiar con una vasta gama de tareas y contextos.

Funcionan como navajas suizas de la Inteligencia Artificial, siendo capaces de responder preguntas, generar texto, traducir, resumir contenidos e incluso escribir código.

Todo esto es posible gracias al entrenamiento masivo en datasets generalistas, como textos de internet, libros, artículos e incluso Repositories de código.

La gran propuesta de estos modelos es la flexibilidad. No fueron creados para resolver un problema específico, sino para actuar en múltiples escenarios, adaptándose a diferentes necesidades sin precisar ajustes adicionales.

Imagina algo que logre tanto ayudar a redactar un contrato como explicar lo básico de un lenguaje de programación. Esa versatilidad es lo que vuelve a los generalistas tan populares, como por ejemplo:

- GPT (OpenAI): ampliamente utilizado para tareas de escritura, como responder preguntas o auxiliar en el aprendizaje.

- Claude (Anthropic): enfocado en interacciones más éticas y explicativas.

- Google Gemini: integración de IA al ecosistema de búsqueda y productividad.

Cuidados importantes

Por más impresionantes que sean, los modelos generalistas tienen una limitación importante: no “saben” las cosas, sino que reproducen patrones de lenguaje basados en el entrenamiento.

Esto significa que, incluso cuando no tienen información concreta sobre un asunto, pueden “alucinar” —es decir, generar respuestas plausibles, pero completamente erróneas.

Si eres curioso como yo, debes estar preguntándote: ¿por qué sucede esto?

- Ausencia de conocimiento real: los modelos no acceden a bases de datos en vivo ni tienen conciencia de la información. Generan respuestas basadas en las estadísticas de lo que parece correcto.

- Excesiva confianza en el contexto: cuando los datos de entrada son vagos o imprecisos, los modelos tienden a “llenar los vacíos” de forma creativa, pero imprecisa.

Otro punto crítico es el impacto que las respuestas erróneas pueden tener en contextos sensibles, como salud, finanzas o cuestiones legales.

Las alucinaciones pueden generar consecuencias graves, especialmente cuando el modelo es utilizado sin supervisión humana.

Los modelos generalistas son increíbles por su versatilidad y potencial de aplicación, pero deben ser usados con cuidado.

Entender sus limitaciones y saber cómo minimizar los riesgos de alucinaciones es esencial para aprovechar lo mejor de estas herramientas de manera responsable.

Modelos especializados

Si los modelos generalistas son los "multitareas", los especializados son los maestros en un único asunto.

Son ajustados mediante Fine-tuning a partir de un modelo base, como el GPT, usando datasets cuidadosamente seleccionados y relacionados con un área o tarea específica.

¿El resultado? Respuestas más precisas y alineadas al contexto.

La idea de los modelos especializados es simple: maximizar la precisión en tareas específicas. Por ejemplo, mientras que un modelo generalista puede llegar a responder una duda médica, un modelo especializado en salud, entrenado con textos científicos y protocolos médicos, ofrecerá respuestas más detalladas y confiables.

Son ideales para situaciones donde no hay margen para errores y el contexto exige un entendimiento profundo, como en el análisis de informes médicos, interpretación de contratos legales o identificación de tendencias en el mercado financiero. Algunos modelos conocidos:

- MediSearch: un modelo especializado en el sector médico. Está entrenado con textos de alta calidad, como artículos científicos y guías clínicas.

- FinBERT: enfocado en el sector financiero, analiza documentos técnicos, informes de mercado y noticias relevantes del área.

Cuidados importantes

Incluso con tanta precisión, los modelos especializados tienen sus limitaciones. Si se utilizan fuera de contexto o con datos de entrada confusos, pueden generar respuestas incorrectas —o incluso peligrosas.

Un MediSearch, por ejemplo, no entenderá modismos o descripciones imprecisas de síntomas, mientras que un FinBERT puede tener dificultades con noticias financieras ambiguas.

Los modelos especializados no tienen la flexibilidad de los generalistas, pero lo compensan con precisión y relevancia en el dominio elegido.

Son herramientas poderosas cuando se usan correctamente, pero necesitan supervisión y un uso consciente.

Modelos compactos

Mientras que los modelos generalistas y especializados brillan en flexibilidad y precisión, los compactos son los maestros de la eficiencia.

Diseñados para ejecutarse en dispositivos con recursos limitados, como smartphones, smartwatches o sistemas embebidos, equilibran la capacidad con la performance.

La gran ventaja de los modelos compactos es viabilizar el uso de IA en escenarios donde no es posible contar con una infraestructura robusta o conexiones estables a la Cloud.

Se reducen en tamaño y se optimizan para consumir menos memoria y procesamiento, pero aun así logran realizar tareas relevantes, como reconocimiento de voz, procesamiento de lenguaje natural e incluso clasificación de imágenes.

Un modelo de este tipo que es muy famoso es el LLaMA 2 (de Meta), una versión optimizada para ejecutarse localmente en dispositivos más pequeños, sin depender de servidores remotos.

Naturalmente, este enfoque "fitness" tiene sus restricciones. Los modelos compactos pierden parte de la capacidad de los generalistas y especializados. Esto significa que, para problemas más complejos, pueden no ser la mejor elección.

Cuidados importantes

Es importante limitar el alcance de los modelos compactos a tareas específicas y bien definidas, garantizando que se usen donde realmente tienen sentido.

Además, es crucial equilibrar calidad y performance, ya que una compactación excesiva puede comprometer el desempeño.

Por último, el entrenamiento personalizado para el caso de uso específico es indispensable para maximizar la eficacia del modelo.

Modelos multimodales

Si los generalistas son los "multitareas" y los especializados los maestros de un nicho, los multimodales son los políglotas de la inteligencia artificial.

Estos modelos tienen la capacidad de entender y procesar diferentes tipos de datos —texto, imagen, audio e incluso video— de forma integrada.

El gran diferencial de los modelos multimodales es la habilidad de conectar información de varias fuentes para ofrecer respuestas más completas y contextualmente ricas.

Piensa en algo que logre interpretar una imagen, explicar lo que hay en ella con texto y además sugerir acciones con base en ese entendimiento. Es como tener un asistente que no solo lee, sino que también ve y oye.

Algunos ejemplos famosos de LLM multimodales:

- DALL-E (OpenAI): Genera imágenes a partir de descripciones textuales (Prompts).

- Flamingo (DeepMind): Capaz de entender y combinar texto e imagen para realizar tareas como generar leyendas para fotos.

- Whisper (OpenAI): Modelo de transcripción y traducción de audio a texto, conectando habla y escritura de forma eficaz.

Cuidados importantes

A pesar de sus súper habilidades, los modelos multimodales enfrentan desafíos importantes.

Uno de ellos es el desbalance de datos, ya que los textos suelen ser más abundantes y de mejor calidad en comparación con las imágenes o videos, lo que puede introducir sesgos en los resultados.

Además, la interpretación de contextos multimodales puede ser ambigua, pues una misma imagen puede tener significados diferentes dependiendo del texto que la acompaña, haciendo esencial el alineamiento cuidadoso de los datos de entrada.

Los modelos multimodales son como el eslabón perdido de la inteligencia artificial, conectando texto, imagen, audio y video de manera integrada y eficiente.

Abren puertas a nuevas formas de interacción y automatización, pero aún dependen de una supervisión cuidadosa, especialmente en contextos críticos.

Conclusión

Y bien, ¿lograste entender cómo los diferentes tipos de LLM pueden transformar la forma en que usamos la inteligencia artificial en el día a día?

Desde los generalistas, que hacen de todo, hasta los especializados, con un enfoque quirúrgico en tareas específicas, pasando por los compactos, que brillan en dispositivos con recursos limitados, hasta los multimodales, que conectan texto, imagen y audio como verdaderos políglotas de la IA, cada modelo tiene su papel y desafíos únicos.

Sobre el autor: Vinicios Neves, Tech Lead y Educador, combina código y didáctica desde hace más de una década. Especialista en TypeScript, lidera equipos Fullstack en Portugal e inspira a futuros desarrolladores en la FIAP y Alura. Con un pie en el código y otro en la enseñanza, demuestra que la verdadera ingeniería de software va más allá de las líneas de código. Además de, por supuesto, ser senior en decir "depende".